“`html

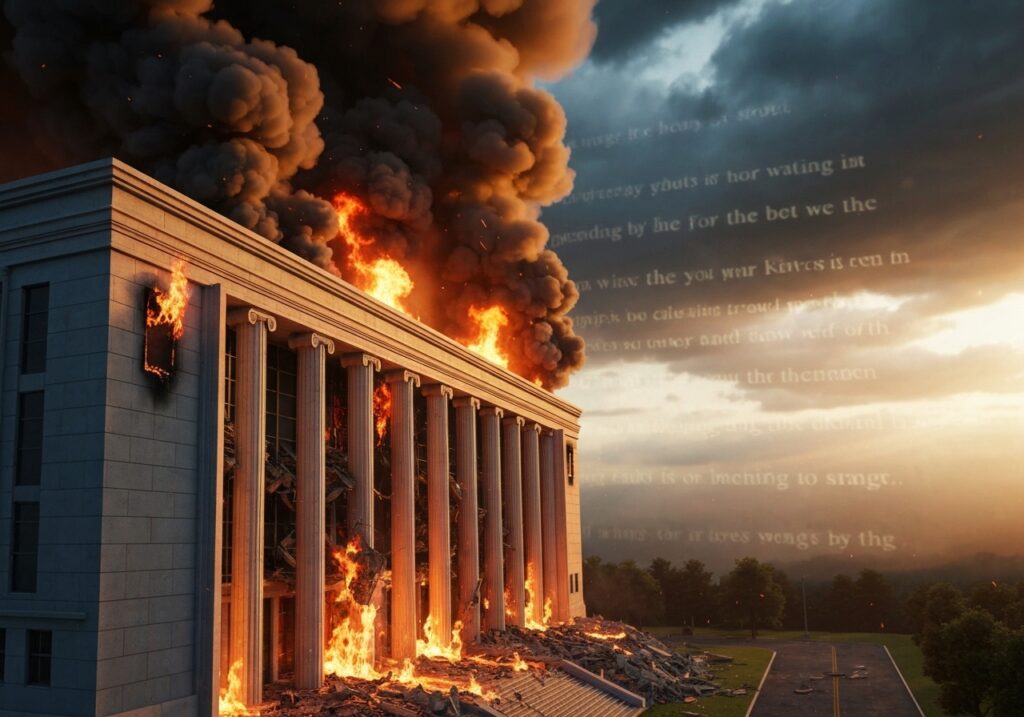

في عالمنا الرقمي، الذي كان في يوم من الأيام منارة للمعلومات والتواصل، أصبح بشكل متزايد ساحة معركة تتشابك فيها الحقيقة والخداع. في عصر تهيمن عليه التطورات التكنولوجية السريعة، اتخذ انتشار المعلومات المضللة بُعدًا جديدًا ومقلقًا من خلال ظهور الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي. ظهرت صورة صادمة لهذا الاتجاه الخطير مؤخرًا مع التداول الكاذب لصورة تم إنشاؤها بواسطة الذكاء الاصطناعي تزعم إظهار “مقر الموساد المحترق”. هذا الحادث، على الرغم من كونه محددًا، يمثل نموذجًا مصغرًا قويًا للتحديات العميقة التي يفرضها الوسائط الاصطناعية في تشكيل الرأي العام، وتغذية الروايات، وإثارة عدم الاستقرار في العالم الحقيقي المحتمل.

صعود المعلومات المضللة الرقمية في عصر الذكاء الاصطناعي

يسلط الحادث المتعلق بصورة “مقر الموساد المحترق” المزعومة الضوء على ضعف حاسم في عالمنا المترابط: سهولة إنشاء ونشر محتوى مرئي مقنع، ولكنه ملفق بالكامل. على عكس التلاعب التقليدي بالصور، الذي غالبًا ما يترك آثارًا قابلة للاكتشاف، تستفيد أدوات الذكاء الاصطناعي الحديثة من خوارزميات متطورة لإنشاء صور فائقة الواقعية من الصفر. هذه ليست مجرد تعديلات؛ إنها بناءات جديدة بالكامل، ولدت من مجموعات بيانات ضخمة ومصممة لمحاكاة الواقع بدقة مزعجة. أصبح الاستخدام الخبيث لهذه التكنولوجيا للدعاية أو تشويه سمعة الكيانات أو خلق الفوضى مصدر قلق عالمي ملح. هذه الصورة بالذات، بآثارها المرئية الصارخة، استفادت من التوترات الجيوسياسية القائمة، مما جعلها أرضًا خصبة للمشاركة السريعة وغير النقدية عبر منصات وسائل التواصل الاجتماعي.

تشريح مزيف: كيف تخدع صور الذكاء الاصطناعي

يتطلب فهم كيفية خداع الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي نظرة سريعة على التكنولوجيا الأساسية. يتم إنشاء معظم الصور الاصطناعية عالية الجودة اليوم باستخدام نماذج التعلم العميق المتقدمة، وغالبًا ما تكون الشبكات التوليدية التنافسية (GANs) أو نماذج الانتشار. تتعلم هذه النماذج من مجموعات هائلة من الصور الواقعية، وتفهم الأنماط والأنسجة والهياكل. يقوم مكون المولد بإنشاء صور، بينما يحاول المكون المميز التمييز بين الصور الحقيقية والمزيفة. من خلال هذه العملية التنافسية، يحسن المولد باستمرار قدرته على إنشاء صور واقعية لدرجة أن المميز نفسه يكافح للتمييز. والنتيجة هي وسائط اصطناعية يمكن أن تخدع العين البشرية، خاصة عند عرضها بسرعة على شاشة صغيرة أو بتنسيق منخفض الدقة.

أتاحت سهولة الوصول إلى أدوات إنشاء صور الذكاء الاصطناعي سهلة الاستخدام هذه التكنولوجيا القوية في أيدي جمهور أوسع، بما في ذلك أولئك الذين لديهم نوايا خبيثة. ما كان يتطلب سابقًا مهارات متخصصة في التصميم الجرافيكي وتحرير الصور يمكن الآن تحقيقه باستخدام مطالبات نصية بسيطة. إن إضفاء الطابع الديمقراطي على إنشاء صور الذكاء الاصطناعي هذا يقلل بشكل كبير من حاجز الدخول لحملات المعلومات المضللة، مما يسهل على الأفراد أو الجهات الفاعلة المدعومة من الدولة إنتاج ونشر المحتوى المفبرك على نطاق واسع. المصداقية المتصورة لهذه الصور تجعلها قوية للسرديات الكاذبة، حيث غالبًا ما تحمل الأدلة المرئية وزنًا أكبر من النص وحده.

الحالة المحددة: تحليل ‘مقر الموساد المحترق’

كانت الصورة التي تزعم إظهار “مقر الموساد المحترق” مثالًا رئيسيًا على مرئي مفبرك مصمم للاستفادة من الإثارة والسياقات الجيوسياسية المحددة. بينما قد تختلف التفاصيل المحددة لإنشاء الصورة والمؤشرات المرئية الدقيقة اعتمادًا على المزيف المحدد الذي تم تداوله، فإن الخصائص المشتركة للصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي غالبًا ما تشمل تناقضات دقيقة يمكن للعيون المدققة أو الأدوات التحليلية اكتشافها. قد تشمل هذه:

- تفاصيل غير منطقية: عناصر لا معنى لها في سياق المشهد، مثل الأجسام العائمة، أو الميزات المعمارية غير الموجودة، أو مصادر الضوء الغريبة.

- أنماط أو نسيج متكرر: نماذج الذكاء الاصطناعي أحيانًا تولد الأنسجة أو الأنماط التي تكون موحدة جدًا أو تتكرر بطرق غير طبيعية، خاصة في مناطق مثل الأنقاض أو الدخان أو أعمال الطوب.

- نص مشوه أو غير منطقي: أي نص داخل صورة تم إنشاؤها بواسطة الذكاء الاصطناعي هو دليل شائع، وغالبًا ما يظهر على شكل هراء، أو ملتوٍ، أو غير متناسق في الأسلوب والحجم.

- آثار الوادي الغريب: على الرغم من التحسن، لا يزال الذكاء الاصطناعي يكافح مع التفاصيل المعقدة مثل الأيدي أو الوجوه (إذا كانت موجودة)، أو الآلات المعقدة، مما يؤدي إلى مظهر غريب أو مقلق بشكل خفي.

- نقص الفيزياء المتسقة: الدخان الذي لا يتصرف بشكل واقعي، أو النار التي تبدو ملصقة، أو الحطام الذي يتحدى الجاذبية يمكن أن تكون مؤشرات.

النية الأساسية وراء تداول مثل هذه الصورة هي دائمًا تقريبًا التلاعب بالرأي العام، أو زرع الشقاق، أو التحقق من التحيزات الموجودة. في سياق كيان حساس للغاية مثل الموساد، يمكن لصورة دمار مفبركة أن تخدم لتعزيز روايات سياسية معينة، أو إثارة المشاعر المناهضة للدولة، أو ببساطة نشر الذعر والارتباك. إن تفنيد هذه المزيفات بسرعة من قبل منظمات تدقيق الحقائق ذات السمعة الطيبة والمصادر الرسمية أمر بالغ الأهمية لمنع الاعتقاد الواسع النطاق والأعمال التبعية القائمة على فرضيات كاذبة.

الغرفة الصدى الخطرة: الانتشار والتأثير

بمجرد دخول صورة مقنعة تم إنشاؤها بواسطة الذكاء الاصطناعي إلى النظام البيئي الرقمي، يمكن أن يكون انتشارها سريعًا بشكل مقلق. تعمل منصات وسائل التواصل الاجتماعي، مع تضخيمها الخوارزمي وآلياتها الفورية للمشاركة، كمسرعات للمعلومات المضللة. غالبًا ما يقوم المستخدمون، مدفوعين بالعاطفة أو التحيز التأكيدي أو الرغبة في أن يكونوا أول من يشارك “الأخبار العاجلة”، بنشر المحتوى دون التحقق من صحته. يؤدي هذا إلى تأثير غرفة الصدى، حيث يتم تكرار المعلومات الكاذبة داخل مجتمعات متشابهة التفكير، مما يعزز مصداقيتها المتصورة. صورة “مقر الموساد المحترق”، على سبيل المثال، من المرجح أن تلقى صدى قويًا داخل المجتمعات التي تميل بالفعل إلى المشاعر المعادية لإسرائيل، أو تلك التي تبحث عن أخبار مثيرة، بغض النظر عن صحتها.

إن العواقب الحقيقية لهذه الخدع الرقمية بعيدة عن أن تكون تافهة. يمكنها:

- تآكل الثقة: يؤدي التعرض المستمر للمحتوى المفبرك إلى صعوبة على الجمهور التمييز بين الحقيقة والخيال، مما يؤدي إلى عدم الثقة العامة في جميع وسائل الإعلام، بما في ذلك مصادر الأخبار المشروعة.

- تغذية التطرف: يمكن للمعلومات المضللة أن تعزز الأيديولوجيات المتطرفة، وتوفر “أدلة مرئية” لمطالبات كاذبة، وقد تؤدي إلى إثارة العنف أو خطاب الكراهية.

- تؤثر على العلاقات الجيوسياسية: يمكن للصور الكاذبة المتعلقة بكيانات الأمن القومي الحساسة أو الأحداث أن تزيد من التوترات بين الدول، أو تؤدي إلى حوادث دبلوماسية، أو حتى تؤثر على قرارات السياسة بناءً على معلومات غير دقيقة.

- تقويض التماسك الاجتماعي: عندما يتم تغذية المجتمعات بإصدارات مختلفة من الواقع، يصبح من الصعب إجراء حوار بناء، مما يؤدي إلى تجزئة المجتمع.

- التسبب في ضرر مالي أو سمعة: بالنسبة للكيانات المستهدفة، يمكن أن يكون تفنيد المزيفات الواسعة النطاق مكلفًا وصعبًا، مما يسبب ضررًا سمعيًا كبيرًا.

سرعة انتشار المعلومات المضللة تعني أن جهود التفنيد غالبًا ما تتأخر، وتكافح لمواكبة الارتفاع الفيروسي الأولي. هذا يسلط الضوء على الحاجة الملحة لاستراتيجيات استباقية في مجال الثقافة الرقمية والتحقق من المحتوى.

مكافحة العدوى: استراتيجيات الثقافة الرقمية

في مواجهة مزيفات الذكاء الاصطناعي المتطورة بشكل متزايد، يعد تنمية مهارات الثقافة الرقمية القوية أمرًا بالغ الأهمية للأفراد. لم يعد كافيًا أن تكون مستهلكًا سلبيًا للمعلومات؛ الشك النشط والتحقق ضروريان.

التفكير النقدي والشك

- تساءل عن المصدر: فكر دائمًا في مكان ظهور الصورة. هل هو من منظمة إخبارية ذات سمعة طيبة، أو قناة حكومية رسمية، أو حساب وسائط اجتماعية غير معروف؟ كن حذرًا من المصادر المجهولة أو تلك التي لديها أجندة واضحة.

- تعرف على التلاعب العاطفي: غالبًا ما تستغل المعلومات المضللة المشاعر القوية مثل الخوف أو الغضب أو السخط. إذا أثارت الصورة رد فعل عاطفيًا فوريًا وشديدًا، فتوقف وتحقق قبل الرد أو المشاركة.

- لا تشارك دون التحقق: قد يكون الدافع للمشاركة في “الأخبار العاجلة” قويًا، لكن المشاركة غير المسؤولة تزيد من المعلومات المضللة. خذ لحظة للتحقق قبل النقر على زر المشاركة هذا.

أدوات وتقنيات التحقق

يمكن لعدة أدوات وتقنيات عملية المساعدة في التحقق من الصور:

- البحث العكسي عن الصور: تتيح لك أدوات مثل صور Google أو TinEye أو Yandex تحميل صورة ورؤية أماكن أخرى ظهرت فيها على الإنترنت. يمكن أن يكشف هذا عما إذا كانت الصورة قديمة، أو تم استخدامها في سياق مختلف، أو مرتبطة بحملة معلومات مضللة معروفة.

- تحليل البيانات الوصفية: على الرغم من أنه غالبًا ما يتم تجريده بواسطة منصات وسائل التواصل الاجتماعي، فإن بعض الصور تحتفظ بالبيانات الوصفية (بيانات EXIF) التي يمكن أن تكشف عن تفاصيل حول الكاميرا المستخدمة، والتاريخ، والموقع. توجد أدوات لعرض ذلك إذا كان متاحًا.

- أدوات كشف الذكاء الاصطناعي: على الرغم من أنها لا تزال قيد التطوير وليست مضمونة، يتم تطوير بعض الأدوات التي تعمل بالذكاء الاصطناعي لتحديد القطع الأثرية التي تشير إلى إنشاء الذكاء الاصطناعي. هذه عادة للاستخدام الخبير ولكنها أصبحت أكثر سهولة.

- المقارنة المرجعية: تحقق مما إذا كانت المنظمات الإخبارية الموثوقة والمستقلة المتعددة تقوم بالإبلاغ عن الحدث المزعوم. إذا كان مصدر واحد غامض فقط يقدم تقريرًا عنه، خاصة مع صورة مثيرة للغاية، فكن متشككًا.

- ابحث عن السياق: هل هناك مقال إخباري مطابق؟ هل تتوافق المعلومات المرئية مع الادعاء النصي؟ التناقضات هي علامات حمراء.

فهم آثار الذكاء الاصطناعي

يعد تدريب عينك على اكتشاف مؤشرات الذكاء الاصطناعي الشائعة مهارة متزايدة القيمة. بالإضافة إلى الشعور العام بـ “الوادي الغريب”، انتبه إلى:

- الأيدي والأصابع: لا تزال تمثل تحديًا سيئ السمعة للذكاء الاصطناعي، ابحث عن عدد كبير جدًا أو قليل جدًا من الأصابع، أو أشكال مشوهة، أو أوضاع غير طبيعية.

- العيون والأسنان: غالبًا ما تبدو مشوهة، أو غير متناظرة، أو ذات بريق غير طبيعي.

- تناقضات الخلفية: أنماط مشوهة أو متكررة في الخلفيات، ضبابية غريبة، أو أشياء تتحدى المنطق.

- الإضاءة والظلال: غالبًا ما تبدو غير متسقة مع مصدر الضوء المفترض.

- الانعكاسات: يمكن أن تكون مشوهة بشكل غريب أو غائبة حيث ينبغي أن تكون.

دور المنصات وصناع السياسات

بينما تعد الثقافة الفردية أمرًا حيويًا، تتحمل شركات التكنولوجيا والحكومات أيضًا مسؤولية كبيرة في مكافحة انتشار المعلومات المضللة التي تم إنشاؤها بواسطة الذكاء الاصطناعي. تحتاج منصات وسائل التواصل الاجتماعي، بصفتها قنوات أساسية للمعلومات، إلى تنفيذ سياسات إشراف أكثر صرامة على المحتوى، والاستثمار في تقنيات الكشف عن الذكاء الاصطناعي، ووضع علامات واضحة على المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي أو التلاعب به. تعد مبادرات المصدر الرقمي، مثل شهادات مصادقة المحتوى أو العلامات المائية التشفيرية التي تشير إلى مصدر الصورة وتعديلاتها، خطوات حاسمة نحو بناء الثقة في الوسائط عبر الإنترنت. تقوم بعض المنصات بالفعل بتجربة أدوات كشف الذكاء الاصطناعي وعلامات “الوسائط الاصطناعية”.

يكافح صناع السياسات على مستوى العالم كيفية تنظيم التزييف العميق والمعلومات المضللة دون انتهاك حرية التعبير. يتضمن ذلك مناقشات حول إلزام الإفصاح عن المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي، وفرض عقوبات على النشر الخبيث، وتعزيز التعاون الدولي لتتبع شبكات المعلومات المضللة وتعطيلها. التوازن بين حماية حرية التعبير وضمان الحماية من المحتوى الضار دقيق، لكن إلحاح التهديد يتطلب أطرًا قانونية وأخلاقية مبتكرة.

التطلع إلى الأمام: المشهد المتطور باستمرار للخداع

تتقدم قدرات الذكاء الاصطناعي بوتيرة مذهلة، مما يعني أن الدقة المرئية للوسائط الاصطناعية ستستمر في التحسن، مما يجعل الكشف أكثر صعوبة. ما يظهر كـ “مؤشر” اليوم قد يتم حله بواسطة نماذج الذكاء الاصطناعي غدًا. هذا يتطلب تكيفًا مستمرًا من مدققي الحقائق والباحثين والجمهور العام. إن مكافحة المعلومات المضللة التي تم إنشاؤها بواسطة الذكاء الاصطناعي ليست معركة لمرة واحدة بل حرب استنزاف مستمرة، تتطلب يقظة مستمرة وتعليمًا وابتكارًا تقنيًا. كما أنه يؤكد على أهمية تعزيز ثقافة استهلاك المعلومات القابلة للتحقق عبر جميع التركيبة السكانية.

خاتمة: الحفاظ على الحقيقة في العصر الرقمي

يعد التداول الكاذب لصورة ذكاء اصطناعي تصور “مقر الموساد المحترق” بمثابة تحذير صارخ للطبيعة الخبيثة للمعلومات المضللة الحديثة. يؤكد على أنه في العصر الرقمي، لم يعد الرؤية تعني بالضرورة الإيمان. مع تطور أدوات الذكاء الاصطناعي وتوفرها بشكل أكبر، تقع مسؤولية تقييم المعلومات التي نستهلكها ونشاركها بشكل نقدي على عاتق كل فرد. من خلال تبني الثقافة الرقمية، واستخدام أدوات التحقق، والدعوة إلى مبادئ توجيهية أخلاقية ولوائح أقوى من المنصات التقنية والحكومات، يمكننا العمل بشكل جماعي للحفاظ على سلامة أنظمة المعلومات لدينا. إن المعركة من أجل الحقيقة في المجال الرقمي أمر بالغ الأهمية، لأنها تستند إليها أسس الخطاب العام المستنير، والثقة المجتمعية، والاستقرار العالمي.

“`