“`html

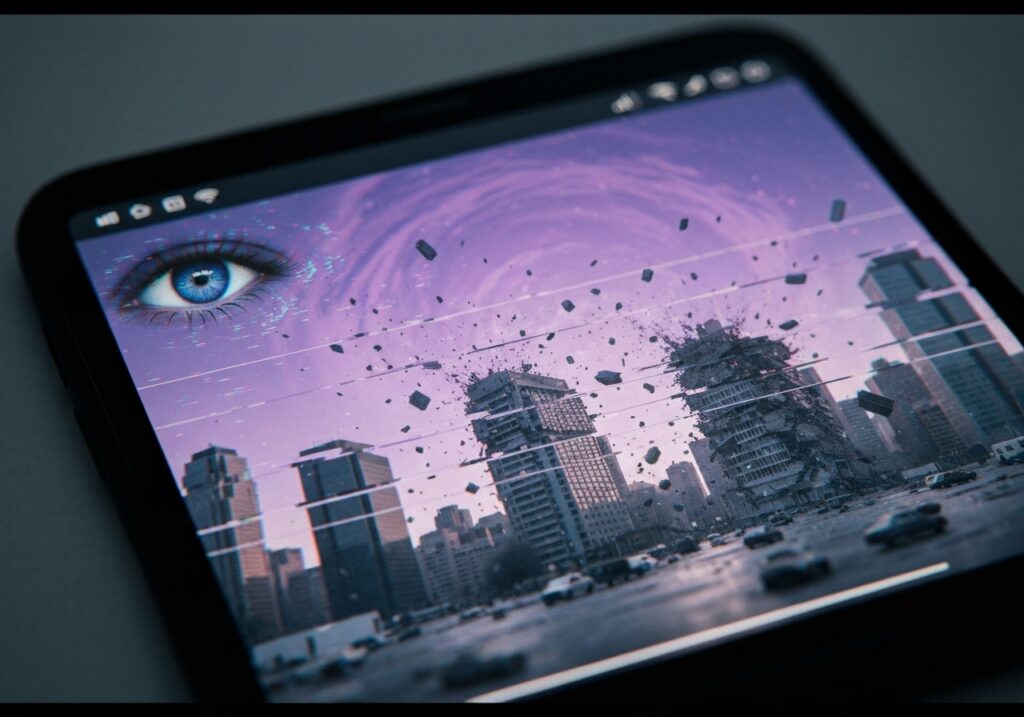

في ظل المشهد العالمي المتزايد التعقيد، أصبحت البيئة المعلوماتية ساحة معركة جديدة، لا سيما في أوقات التوترات الجيوسياسية. يسلط بحث حديث الضوء على اتجاه مقلق ينشأ من الخطاب المستمر حول الصراع بين إيران وإسرائيل: الانتشار الواسع للفيديوهات المتطورة التي تم إنشاؤها بواسطة الذكاء الاصطناعي (AI). هذه الروايات المرئية المفبركة ليست مجرد حوادث معزولة، بل تمثل جهدًا منسقًا للتلاعب بالرأي العام، وزرع بذور الفتنة، وتضخيم الأكاذيب عبر منصات التواصل الاجتماعي الرئيسية. مع تقدم التقنيات الرقمية بوتيرة غير مسبوقة، تتزايد أيضًا القدرة على إنشاء محتوى مرئي مقنع للغاية، ولكنه خيالي تمامًا، مما يتحدى أسس الثقة في المعلومات عبر الإنترنت.

تداعيات هذه المعلومات المضللة عميقة، وتمتد إلى ما وراء العالم الرقمي. يمكن أن تؤثر على الرأي العام، وتفاقم التوترات المحتملة، وحتى تحرض على أعمال في العالم الواقعي. فهم الآليات الكامنة وراء حملات الذكاء الاصطناعي هذه، والتعرف على سماتها المميزة، وتطوير استراتيجيات قوية لمحو الأمية الرقمية أمر بالغ الأهمية في عصر يصبح فيه التمييز بين الحقيقة والزيف مهمة أكثر صعوبة على الإطلاق.

صعود الوسائط الاصطناعية في مناطق النزاع

لقد كانت التوترات الحالية بين إيران وإسرائيل مثالاً صارخًا على مدى سرعة انتشار المعلومات المضللة التي ينشئها الذكاء الاصطناعي. حدد الباحثون العديد من حالات الوسائط الاصطناعية، وخاصة الفيديو، المصممة لتصوير مشاهد دراماتيكية وكارثية في كثير من الأحيان لم تحدث أبدًا. وتشمل هذه:

- مشاهد دمار مفبركة: فيديوهات تصور المباني الشاهقة في تل أبيب وقد تحولت إلى أنقاض أو إسقاط طائرة عسكرية إسرائيلية، وكلها مفبركة بالكامل عبر الذكاء الاصطناعي.

- تقارير خيالية: مقاطع تعرض صورًا رمزية تم إنشاؤها بواسطة الذكاء الاصطناعي تتظاهر بأنها مراسلون، وتنقل أخبارًا من سجون محترقة في طهران، مما يمنح مظهرًا من الأصالة للروايات الكاذبة.

- لقطات أمنية معالجة: فيديوهات خشنة بالأبيض والأسود تدعي أنها لقطات كاميرات مراقبة لانفجارات في مواقع حساسة مثل سجن إيفين، مليئة بالتناقضات البصرية الدقيقة التي تفضح أصلها الاصطناعي.

تم تصميم هذه المقاطع، التي غالبًا ما لا يمكن تمييزها عن اللقطات الحقيقية للعين غير المدربة، لتحقيق أقصى قدر من التأثير والانتشار. إنها تستغل الاستجابات العاطفية، متجاوزة التحليل النقدي في دورة أخبار سريعة الوتيرة. سمح الانتشار السريع عبر منصات مثل X (تويتر سابقًا) وتيك توك لبعض هذه الفيديوهات بجمع ملايين المشاهدات، مما يشكل بشكل أساسي الروايات التي تستهلكها جماهير واسعة على مستوى العالم.

تشريح المعلومات المضللة التي ينشئها الذكاء الاصطناعي

لقد أدت التطورات في أدوات الذكاء الاصطناعي المتاحة اليوم إلى خفض الحاجز أمام إنشاء محتوى مزيف مقنع بشكل كبير. ما كان يتطلب في السابق مهارات تقنية متقدمة وموارد كبيرة يمكن تحقيقه الآن بسهولة نسبية، باستخدام البرامج المتاحة على نطاق واسع والخدمات السحابية. يوضح خبراء مثل هاني فريد، أستاذ في جامعة كاليفورنيا، بيركلي، والمؤسس المشارك لشركة ناشئة للكشف عن الذكاء الاصطناعي GetReal Labs، أن التطورات الأخيرة مكنت من إنشاء تسلسلات فيديو كاملة تحاكي أحداث العالم الواقعي، كاملة بعناصر ديناميكية مثل الانفجارات وتأثيرات الكاميرا المحمولة باليد الظاهرة.

غالبًا ما تتضمن العملية أداة تحويل الصور إلى فيديو بالذكاء الاصطناعي، والتي يمكنها أخذ صورة ثابتة أو سلسلة من الصور وإنشاء حركة وتأثيرات واقعية. أصبحت هذه الأدوات بارعة بشكل متزايد في محاكاة الإضاءة والظلال والأنسجة، وحتى العيوب الدقيقة للتصوير الفوتوغرافي والفيديو الواقعي، مما يجعل اكتشاف الشذوذات البصرية أكثر صعوبة. ومع ذلك، لا تزال العيون المدربة والأدوات المتخصصة للتحقيق قادرة على تحديد علامات مثل:

- تناقضات في التفاصيل: اختلافات في اللافتات أو الشعارات أو الميزات المعمارية التي لا تتطابق مع الموقع المزعوم.

- حركات غير طبيعية: عيوب طفيفة، تكرارات، أو مشكلات في سلاسة حركة الأشخاص أو الأشياء التي تفضح أصلها الاصطناعي.

- شذوذات الإضاءة والظلال: إضاءة لا تتصرف بشكل واقعي أو ظلال تقع بشكل غير صحيح بناءً على مصادر الضوء الظاهرة.

- نصوص أو وجوه مشوهة: النص الذي ينشئه الذكاء الاصطناعي غالبًا ما يبدو مشوشًا أو مشوهًا، والوجوه، على الرغم من كونها واقعية بشكل متزايد، يمكن أن تظهر أحيانًا تأثيرات “الوادي الغريب” أو تشوهات طفيفة عند الفحص الدقيق.

غالبًا ما تفوت هذه العيوب الدقيقة من قبل المشاهدين العاديين، خاصة عند استهلاك المحتوى بسرعة على الأجهزة المحمولة ذات شاشات العرض منخفضة الدقة.

القوى الدافعة: شبكات منسقة وأجندات جيوسياسية

نادرًا ما يكون انتشار المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي عشوائيًا. أشار باحثون في مركز وسائل الإعلام الجنائية بجامعة كليمسون إلى أدلة على شبكات منسقة تنشط في تضخيم هذا المحتوى المفبرك. في سياق الصراع بين إيران وإسرائيل، يبدو أن بعض هذه الحملات مرتبطة بجهات فاعلة تروج لرسائل المعارضة الإيرانية. الهدف الأساسي هو غالبًا إثارة الشك وتقويض ثقة الجمهور في الحكومة الإيرانية، والاستفادة من الشدة العاطفية للأزمة لدفع روايات سياسية محددة.

يؤكد دارين لينفيل، المدير المشارك لمركز وسائل الإعلام الجنائية، أنه بينما التكنولوجيا نفسها ليست جديدة تمامًا، إلا أن الذكاء الاصطناعي يمكّن هذه العمليات من العمل بكفاءة غير مسبوقة. “إنها لا تفعل أي شيء لا يمكن للمرء القيام به بالتكنولوجيا السابقة،” قال لينفيل، “إنها فقط تفعل كل شيء بتكلفة أقل وأسرع وبحجم أكبر.” هذا يسلط الضوء على تحول حاسم: دمقرطة أدوات المعلومات المضللة. يمكن للجهات الفاعلة التي ترعاها الدولة، أو الجماعات النشطة، أو حتى الأفراد الآن إنتاج وسائط مزيفة عالية الجودة دون الموارد الواسعة المطلوبة تقليديًا، مما يجعل مصدر هذه الحملات صعب التتبع بشكل متزايد.

الدوافع وراء مثل هذه الحملات متعددة الأوجه:

- زعزعة الاستقرار: خلق الارتباك والخوف لزعزعة استقرار الخصوم السياسيين أو الدول المنافسة.

- الدعاية: تعزيز أجندات سياسية أو أيديولوجية محددة من خلال تصوير الأحداث بشكل مشوه أو كاذب تمامًا.

- تقويض الثقة: تآكل ثقة الجمهور في وسائل الإعلام الرئيسية، والمصادر الرسمية، وحتى في مفهوم الحقيقة الموضوعية نفسها، مما يمهد الطريق للواقع البديل المفبرك.

- الاستقطاب: تفاقم الانقسامات المجتمعية القائمة من خلال مناشدة المشاعر القوية والتحيزات الموجودة مسبقًا.

استجابات المنصات والتحدي المستمر

تجد منصات التواصل الاجتماعي نفسها في طليعة هذه المعركة ضد المعلومات المضللة التي ينشئها الذكاء الاصطناعي. تختلف استراتيجيات الاستجابة الخاصة بها، ومع ذلك تواجه جميعها تحديات كبيرة في مواكبة التطور السريع لقدرات الذكاء الاصطناعي. تيك توك، على سبيل المثال، ذكرت أنها تحظر المعلومات المضللة الضارة والمحتوى الذي ينشئه الذكاء الاصطناعي الذي يزيف مصادر موثوقة أو أحداث الأزمات، مؤكدة أنها أزالت بعض مقاطع الفيديو المتعلقة بالصراع بين إيران وإسرائيل. X، من ناحية أخرى، غالبًا ما تعتمد على ميزة “ملاحظات المجتمع” الخاصة بها، وهو نظام للتحقق من الحقائق تم تجميعه من قبل المستخدمين، لإضافة سياق أو تحذيرات للمنشورات المضللة المحتملة.

ومع ذلك، غالبًا ما تكون هذه الإجراءات تفاعلية وليست استباقية. بحلول الوقت الذي يتم فيه تحديد الفيديو والتحقق منه وربما إزالته أو تمييزه، قد يكون قد جمع بالفعل ملايين المشاهدات، تاركًا انطباعًا دائمًا لدى عدد لا يحصى من المستخدمين. إن الحجم الهائل للمحتوى الذي يتم تحميله يوميًا، جنبًا إلى جنب مع التطور المتزايد للذكاء الاصطناعي، يجعل الكشف الآلي تحديًا تقنيًا هائلاً. علاوة على ذلك، فإن الطبيعة العالمية لهذه المنصات تعني أن سياسات الإشراف على المحتوى يجب أن تتعامل مع السياقات الثقافية المتنوعة والأطر القانونية، مما يزيد من تعقيد التنفيذ.

يستمر الجدل حول مسؤولية المنصات في التصاعد. يجادل النقاد بأن المنصات بحاجة إلى الاستثمار بشكل أكبر في تقنيات الكشف عن الذكاء الاصطناعي، وتنفيذ سياسات محتوى أكثر صرامة، وأن تكون أكثر شفافية بشأن أصل المحتوى، لا سيما خلال الأحداث العالمية الحساسة. ومع ذلك، غالبًا ما تدافع المنصات، مشيرة إلى صعوبة التمييز بين السخرية والتعبير الإبداعي والمعلومات المضللة الخبيثة، مع التعامل أيضًا مع مخاوف تتعلق بحرية التعبير.

التنقل في مشهد معلومات الذكاء الاصطناعي: نصائح للمستخدمين

في بيئة مشبعة بالوسائط الاصطناعية، يصبح التعليم الإعلامي الفردي هو أقوى دفاع. بينما ينصح الخبراء مثل هاني فريد بصراحة، “توقف عن الحصول على أخبارك من وسائل التواصل الاجتماعي، خاصة فيما يتعلق بالأحداث العاجلة مثل هذه”، إلا أن مثل هذا التصريح الشامل غالبًا ما يكون غير عملي للكثيرين الذين يعتمدون على هذه المنصات للحصول على المعلومات. يتضمن النهج الأكثر دقة تطوير مهارات التفكير النقدي وتبني عادات تعزز الاستهلاك المسؤول للمعلومات:

- التحقق من المصادر: طالما تساءل عن مصدر المحتوى الدرامي أو المثير. هل هو من مؤسسة إخبارية ذات سمعة طيبة؟ هل للحساب تاريخ في مشاركة معلومات دقيقة؟ تحقق من قسم “نبذة عنا” للمواقع غير المألوفة.

- المقارنة المرجعية: قبل قبول أي ادعاء كحقيقة، ابحث عن تأكيد من مصادر إخبارية متعددة ومتنوعة وذات مصداقية. إذا كان مصدر واحد فقط يقدم شيئًا غير عادي، فكن متشككًا.

- ابحث عن الشذوذات: درب عينيك على اكتشاف التناقضات الدقيقة الموجودة غالبًا في مقاطع الفيديو التي ينشئها الذكاء الاصطناعي: ضبابية غريبة، حركات غير طبيعية، خلفيات مشوهة، أو نصوص لا تبدو منطقية تمامًا. استمع إلى جودة صوت غير عادية أو أصوات آلية.

- ضع في اعتبارك السياق: هل تم تصميم المحتوى لإثارة رد فعل عاطفي قوي؟ هل يتوافق تمامًا مع أجندة سياسية محددة؟ غالبًا ما تعتمد المعلومات المضللة على المخاوف أو الغضب أو التحيزات القائمة.

- كن حذرًا من السرعة: بيئات الأخبار العاجلة هي أرض خصبة للمعلومات المضللة. كن حذرًا من “التقارير الأولى” أو المحتوى الذي تم مشاركته فورًا بعد حدث ما، حيث غالبًا ما تكون هذه غير موثقة أو مفبركة.

- استخدم أدوات التحقق من الحقائق: استفد من منظمات ومواقع التحقق من الحقائق الراسخة (مثل Snopes، PolitiFact، AP Fact Check، Reuters Fact Check) التي غالبًا ما تفند المعلومات المضللة الفيروسية بسرعة.

- فكر قبل المشاركة: قاوم الرغبة في مشاركة المحتوى الذي لم يتم التحقق منه. كل مشاركة تضخم الرسالة، بغض النظر عن صحتها.

التداعيات الأوسع على الجيوسياسة والثقة

يشكل انتشار المعلومات المضللة التي ينشئها الذكاء الاصطناعي، لا سيما خلال النزاعات الجيوسياسية الحرجة، تهديدًا كبيرًا للاستقرار العالمي والعمليات الديمقراطية. عندما لا يستطيع المواطنون التمييز بين الأحداث الحقيقية والأحداث المفبركة، فإن أساس اتخاذ القرار المستنير يتآكل. يمكن أن يؤدي هذا إلى:

- تآكل الثقة: عدم ثقة واسع النطاق في المؤسسات ووسائل الإعلام وحتى المواطنين الآخرين، مما يخلق مجتمعًا مجزأً.

- زيادة الاستقطاب: تعميق الانقسامات مع انسحاب الأفراد إلى غرف الصدى، واستهلاك المعلومات التي تؤكد تحيزاتهم الحالية فقط.

- تصعيد النزاعات: يمكن استخدام الروايات المفبركة لتبرير العدوان أو التحريض على العنف أو إطالة أمد النزاعات من خلال تشويه الحقائق على أرض الواقع.

- التلاعب بالناخبين: خلال الانتخابات، يمكن استخدام المحتوى الذي ينشئه الذكاء الاصطناعي لنشر روايات كاذبة حول المرشحين أو الأحزاب، مما يؤثر على النتائج الانتخابية.

يتطلب التصدي لهذا التحدي نهجًا متعدد الأوجه يشمل الحلول التكنولوجية (كشف أفضل للذكاء الاصطناعي)، وأطر السياسات واللوائح (مساءلة المنصات، والتبعات القانونية لنشر المعلومات المضللة)، والمبادرات التعليمية (تعزيز التفكير النقدي ومحو الأمية الرقمية من سن مبكرة). إنه سباق تسلح مستمر حيث تتطور أدوات الخداع باستمرار، مما يتطلب آليات دفاعية متكيفة بنفس القدر.

الخاتمة

يقدم الصراع في الشرق الأوسط دراسة حالة حرجة لاستخدام الذكاء الاصطناعي كسلاح في حرب المعلومات. مقاطع الفيديو التي ينشئها الذكاء الاصطناعي، والمصممة للخداع والتلاعب، لم تعد مفهومًا مستقبليًا بل واقعًا حاضرًا له تأثيرات ملموسة. بينما تسعى منصات التواصل الاجتماعي جاهدة لتطبيق إجراءات وقائية، تقع المسؤولية النهائية عن تمييز الحقيقة على عاتق المستخدم الفرد.

في هذا العصر الرقمي الجديد، الاستقصاء النقدي ليس مجرد تمرين أكاديمي؛ بل هو مهارة أساسية للمشاركة المدنية والرفاهية الشخصية. من خلال البقاء يقظين، والتشكيك فيما نراه، والبحث عن المعلومات من مصادر موثوقة ومتنوعة، يمكننا بناء نظام بيئي معلوماتي أكثر مرونة بشكل جماعي والحماية من القوة الخفية للأكاذيب المدعومة بالذكاء الاصطناعي.

“`